「AIを導入したのに、成果が出ない」——この相談が、2026年に入ってから急増している。

原因はAIの性能ではない。教育の仕組みがないことだ。 本記事では、AIがAIを自動で教育する「Auto Agent」の概念と、Claude Codeで実践したAI社員育成の具体的な仕組みを解説する。

AI導入=コスト削減は短絡的だ

「ChatGPTを導入すれば月100万円のコスト削減になる」。こういう導入提案をよく見る。

半分正解で、半分嘘だ。

導入しただけのAIは、教育を受けていない新人と同じだ。指示しなければ動かない。指示が曖昧なら意図と違う成果物が出てくる。放置すれば、いつまでも同じミスを繰り返す。

私自身、AI社員の導入初期に「ざっくり指示すれば大丈夫だろう」と思い込み、品質崩壊を経験した。検索フォームのフィルタが別画面に分離され、ページネーションは全件取得のフロント分割。テストは通るが仕様と違う。この失敗から学んだのは、AIへの投資は「導入費」ではなく「教育費」だということだ。

新人教育とAI教育は、本質が同じだ

人間の新人教育を思い出してほしい。

| 項目 | 人間の新人教育 | AI社員の教育 |

|---|---|---|

| マニュアル | 業務手順書 | CLAUDE.md(指示書) |

| OJT | 先輩の横で学ぶ | hooks(作業中に自動学習) |

| 引き継ぎ | ノート、口頭 | memory(永続記憶) |

| 評価 | 上司のフィードバック | LLM-as-Judge(AI評価) |

| 成長速度 | 月〜年単位 | 日〜週単位 |

仕組み化しなければ育たない。これは人間もAIも同じだ。

ただし決定的な違いが2つある。再現性と速度だ。人間は「教えたのにできない」がある。AIは仕組みさえ整えれば100%再現する。そして人間が月単位で成長するところを、AIは日単位で成長する。

つまり、教育の仕組みへの投資対効果は、AIのほうが圧倒的に高い。

Auto Agentとは何か

ここで本題だ。2026年、AI業界で急速に広がっている概念がある。Auto Agent——AIがAIを自動で教育・改善する仕組みだ。

従来のAI活用は「人間がプロンプトを書き、出力を確認し、手動でチューニングする」サイクルだった。Auto Agentはこれを自動化する。人間は教育方針を伝えるだけ。チューニングはAIがやる。

自己改善ループの基本構造

Auto Agentの核は、5ステップの自己改善ループだ。

- 分析(Analyze): 自分の出力を評価する

- 計画(Plan): 改善点を特定する

- 修正(Modify): プロンプトや設定を自動で書き換える

- 評価(Evaluate): 新しい設定で再実行し、スコアを比較する

- 判定(Keep/Revert): 改善されていれば採用、悪化していれば元に戻す

このループが、人間の介入なしに繰り返される。OpenAIのSelf-Evolving Agents Cookbookでは、この仕組みを「自律的リトレーニング」と呼んでいる。

世界はAuto Agentに向かっている

2026年、Auto Agentの実例が一気に増えた。3つ紹介する。

1. Karpathyのautoresearch — 700実験を自動実行

元OpenAI/Tesla AIディレクターのAndrej Karpathyが開発したautoresearchは、AIエージェントが2日間で700の機械学習実験を自動実行するシステムだ。

仕組みはシンプルだ。plain textファイルに「明確な指示、制約、停止基準」を書き、AIに修正可能なコードとメトリクスを渡す。AIは自動で実験を繰り返し、20個の最適化手法を発見した。

成果は数字に出ている。

- より大きなモデルに適用 → 訓練時間11%短縮

- Shopify CEOが試用 → 一晩37実験で19%パフォーマンス向上

2. Meta Hyperagents — AIが自分の改善プロセスを書き換える

Metaが発表したHyperagentsは、さらに一歩先を行く。通常のAIエージェントは「タスクの実行方法」を改善する。Hyperagentsは**「改善のプロセスそのもの」を書き換える**。

タスクを解くAIと、そのAIの改善方法を考えるメタAIが、1つのプログラムの中で自己参照的に動く。ロボティクス、論文レビュー、数学の各ドメインで、従来のメタ学習を大幅に上回る成果を出した。

3. MiniMax M2.7 — 自分の訓練に参加したAIモデル

中国のMiniMaxが公開したM2.7は、自分自身の訓練に参加した初のオープンソースモデルだ。

100回以上の自律的な最適化ラウンド——「失敗分析→計画変更→コード修正→評価→採用/棄却」——を人間の介入なしに実行し、内部ベンチマークで30%の改善を達成した。

実践:Claude Codeで作るAuto Agentの3層構造

業界の動向は分かった。では、今日から使える実践はどうか。

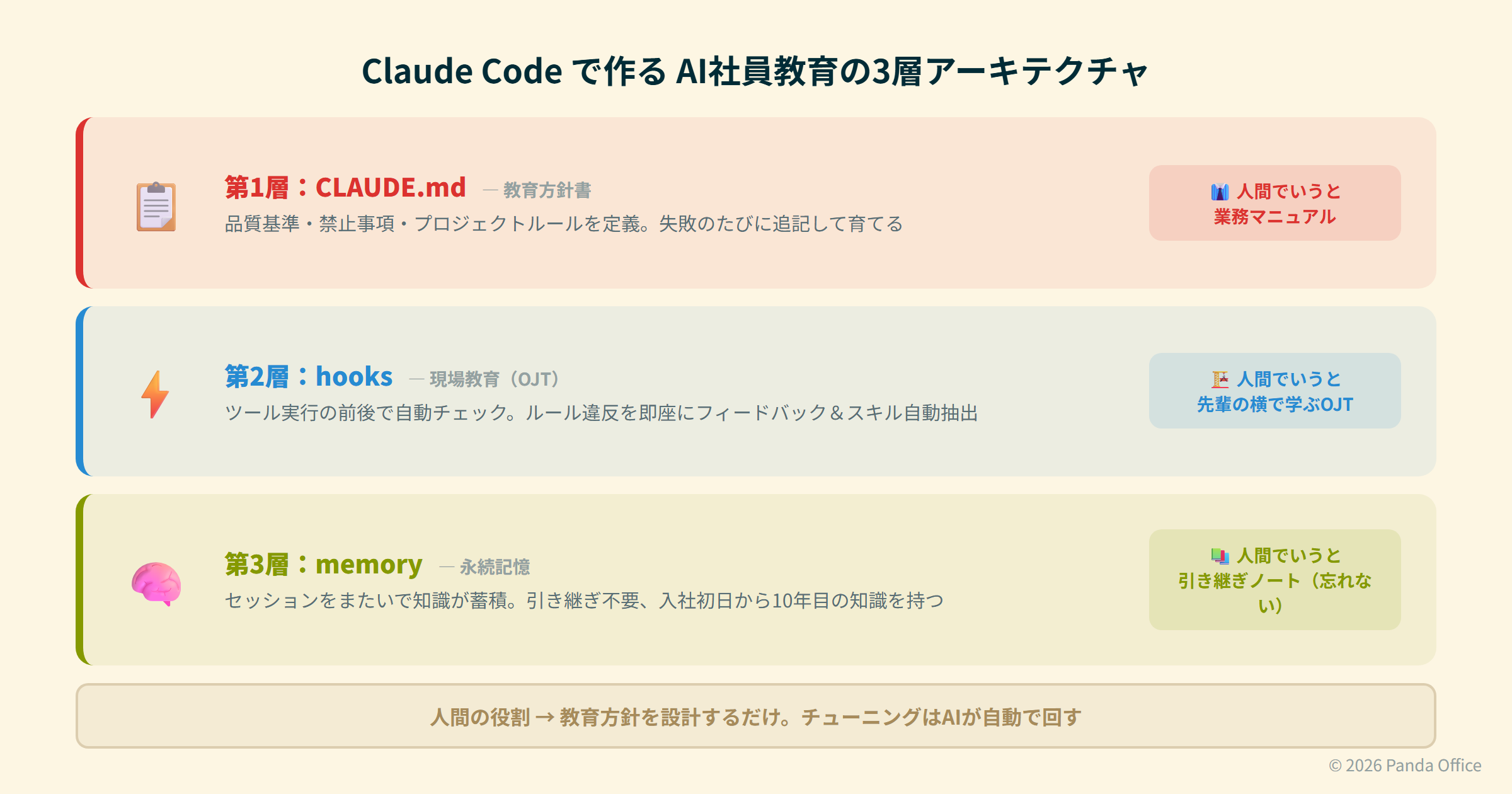

私がClaude Codeで実装しているAI社員教育の仕組みは、3つの層で構成される。

第1層:CLAUDE.md — 教育方針書

CLAUDE.mdは、AI社員の「業務マニュアル」だ。プロジェクトのルール、品質基準、禁止事項をここに書く。

## デグレ防止ルール(最重要)

- 既存機能に影響する変更は関連テストを先に確認

- テストが通ることを確認してから次に進む

- 「動いているコード」は理由なく触らない

重要なのは、CLAUDE.mdを一度書いたら終わりではないことだ。私は台本制作でCH01からCH04まで4章分の校閲ルールを蓄積してきた。モノローグ制限、掛け合いパターン、用語統一——失敗のたびにルールを追加し、CLAUDE.mdを育てた。

これは人間の教育でいえば「マニュアルを現場の声で改訂し続ける」のと同じだ。

第2層:hooks — 作業中の自動学習

CLAUDE.mdが「事前教育」なら、hooksは「OJT(現場教育)」だ。

Claude Codeのhooksは、ツール実行の前後で自動的にシェルスクリプトを走らせる仕組みだ。私が実装しているのは以下のような自動学習ループだ。

- PreToolUse: mainブランチへの直接commitをブロック(ルール違反の即時フィードバック)

- PostToolUse: ファイル編集時にファクトチェックを実行(品質の自動検証)

- Stop: セッション終了時に未コミット変更を警告(作業漏れの防止)

さらに、Claudeceptionのようなコミュニティツールでは、Claude Codeが作業中に「再利用可能なスキル」を自動抽出し、次回以降に自動で適用する。これはまさにAIがAIを教育する仕組みだ。

第3層:memory — 忘れない引き継ぎ

人間の新人教育で最も非効率なのは「引き継ぎ」だ。前任者の知識が口頭でしか伝わらない。ノートに書いても読まれない。

AIにはこの問題がない。

Claude Codeのmemory(memory/MEMORY.md)に書いた情報は、セッションをまたいで永続する。一度学んだパターンは二度と忘れない。私のプロジェクトでは、キャラ設定、構成ルール、掛け合いパターン、ゴールドスタンダード(模範例)がすべてmemoryに蓄積されている。

memory/MEMORY.md

├── キャラ設定(2026-03-16確定)

├── 掛け合い強化3原則

├── 構成ルール(Webリサーチ4並列で確立)

└── ゴールドスタンダード(CH01-04の参照箇所)

新しいセッションを開始しても、AI社員は「前回の続き」から始められる。これは、入社初日から10年目の社員と同じ知識を持っているのと同じだ。

人間の役割は「教育方針の設計」だけだ

Auto Agentの時代に、人間がやるべきことは明確だ。

プロンプトを書くことではない。教育の仕組みを設計することだ。

| やること | やらなくていいこと |

|---|---|

| 品質基準を定義する | 毎回プロンプトを書く |

| 評価指標を設計する | 出力を手動でチェックする |

| 教育ルールを更新する | 同じ修正を繰り返す |

| 失敗パターンを分析する | AIの代わりに作業する |

これはPMBOK-AIの第4の柱「継続的な学習ループ」そのものだ。PMの仕事は「管理」から「教育アーキテクトへ」と変化している。

1人社長からAIチーム体制へ移行した過程を振り返ると、Phase 0(AI丸投げ)からPhase 5(AI社員チーム)まで、やっていたことの本質は「AIの教育環境を整備し続けること」だった。

まとめ:放置したAIは育たない

3つのポイントを整理する。

- AI導入=コスト削減は短絡的だ。 教育投資なしのAI導入は、新人を放置するのと同じ

- Auto Agentの波が来ている。 AIがAIを教育する仕組みは、Karpathy・Meta・MiniMaxが実証済み

- 今日から始められる。 Claude CodeのCLAUDE.md・hooks・memoryの3層で、AI社員の教育アーキテクチャは構築できる

AIの進化速度は加速している。Claude Codeは5週間で30回以上アップデートされた。このスピードについていくには、人間が毎回チューニングするのではなく、教育の仕組みそのものを自動化するしかない。

人間がやるべきは、教育方針を設計すること。チューニングはAIに任せる。

それがAuto Agentの本質であり、PMの新しい仕事だ。